Специально обученные алгоритмы распознают некоторые объекты практически со стопроцентной точностью. Например, полицейские дорожные камеры отлично распознают номера машин. Но это специализированные системы. А вот у «универсального ИИ» с распознаванием объектов до сих пор проблемы. Доходит до смешного. Джефф Клун (Jeff Clune) с коллегами из университета Вайоминга в Ларами скрестил алгоритм генерации случайных изображений с системой распознавания образов — и результаты оказались очень забавными.

Начнём с того, что компьютерное зрение (как область ИИ) работает не так, как человеческое. Оно основано на обучаемых алгоритмах, которые после тренировки на больших коллекциях фотографий вырабатывают специфические признаки, по которым можно отличить один объект от другого: например, кошку от кофейной чашки. В этом же и слабое место ИИ.

Есть алгоритмы генерации случайных «художественных» изображений, которые иногда могут создать объекты, напоминающие что-нибудь настоящее. Если отбирать среди них самые лучшие, то рано или поздно можно натолкнуться на настоящее произведение искусства (это из серии, что тысяча обезьян за миллион лет напечатает «Войну и мир»).

Скрестив алгоритм генерации случайных изображений с системой распознавания образов, Джефф Клун рассчитывал получить похожий результат без человеческого участия — он ожидал коллекцию легко узнаваемых красивых изображений. Для распознавания образов Джефф взял одну из лучших нейросетей AlexNet.

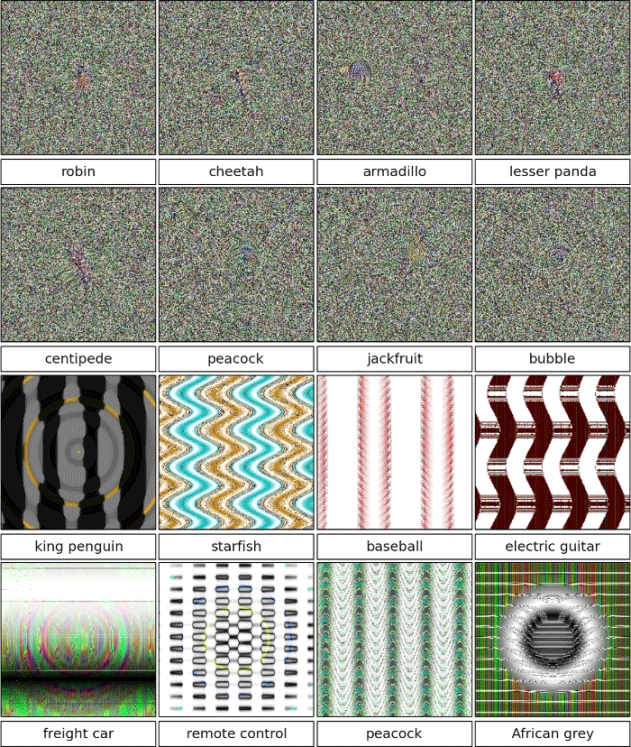

Но на выходе оказалось нечто совершенно иное. На картинках, напоминающих статичный шум, AlexNet уверенно узнавал различных животных и другие объекты, определяя точность распознавания как 99,96% и больше. Некоторые из таких объектов показаны на иллюстрации. Например, во втором ряду — многоножка, павлин, джекфрут и пузырь.

Эти картинки стали для нейросети в своём роде «оптическими иллюзиями». Как человеческое зрение легко обмануть, так и у компьютерного зрения есть «глюки». Люди ведь тоже «видят» объекты там, где их нет: в кляксах и облаках, а ещё легко находят «взаимосвязи» между любыми случайными фактами (что, кстати, порождает множество «теорий заговора»). Просто компьютерные глюки — специфические, не такие как наши.

Результаты научной работы Клуна с коллегами опубликованы на arXiv. Сейчас учёные работают над тем, как защитить системы компьютерного зрения от подобных хаков.