На этой неделе актер Том Хэнкс, ведущая ток-шоу CBS Mornings и известный ютубер MsBeast предупредили, что мошенники используют их образы в рекламе, которая создается при помощи ИИ.

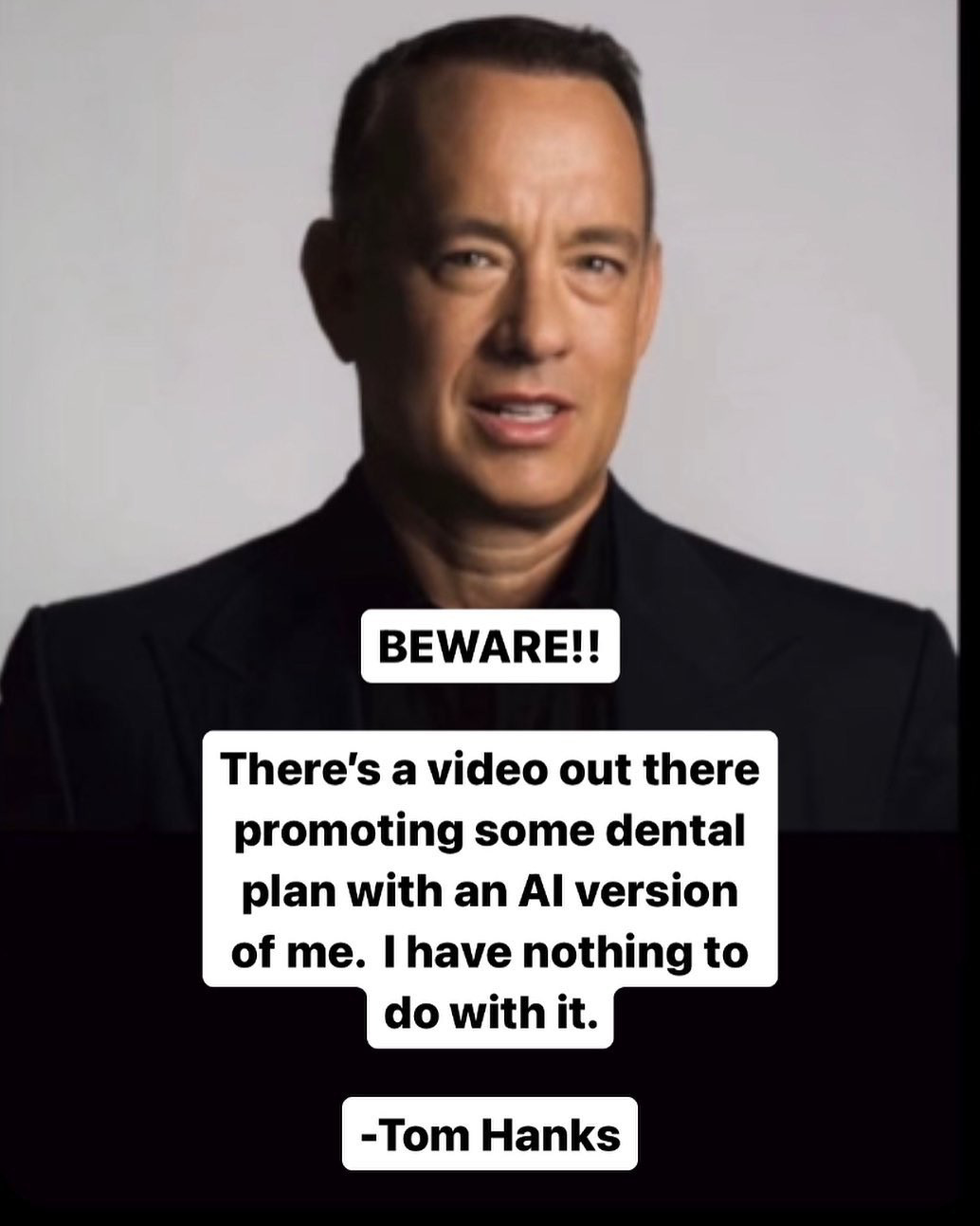

Первым о рекламных дипфейках предупредил своих подписчиков Том Хэнкс, сообщив в Instagram*, что его образ, оказывается, используется в ИИ-рекламе некой схемы стоматологического обслуживания. Актер подчеркнул, что не имеет к этому никакого отношения. «Я никогда не слышал об этом продукте и не использовал его! Пожалуйста, не дайте обмануть себя этими ИИ-видео», — писал Хэнкс.

Вскоре после этого похожее предупреждение опубликовала телеведущая CBS Гейл Кинг, обнаружившая, что ее образ используется для дипфейковой рекламы продуктов для похудения.

Затем с обращением к своим подписчикам выступил известный ютубер MrBeast. В социальной сети X (бывший Twitter) MrBeast заявил, что ему показали дифпейковое видео, где его речь и движения губ созданы с помощью ИИ, и мошенники рекламируют таким способом фальшивую раздачу iPhone 15. К своему посту ютубер приложил сам фейковый ролик, который можно увидеть ниже.

«Многие люди видели эту мошенническую дипфейк-рекламу с моим участием, — пишет MrBeast. — Готовы ли платформы социальных сетей справиться с ростом количества дипфейков и использованием искусственного интеллекта? Это серьезная проблема».

Судя по всему, все эта мошенническая реклама была создана с помощью ИИ-инструментов, которые позволяют изменить артикуляцию человека в кадре, а голоса тоже синтезированы ИИ (1, 2) на основе свободно доступных в сети образцов.

Как уже не раз предупреждали эксперты, убедительные дипфейки, созданные с помощью ИИ, становятся все более острой проблемой, которая в будущем может в целом подорвать доверие и поставить под угрозу надежность современных коммуникационных технологий, так как придется сомневаться буквально во всем.

В настоящее время такие гиганты, как Google и OpenAI, работают над внедрением «водяных знаков» в контент, сгенерированный искусственным интеллектом, а также специальных метаданных, которые помогут отслеживать его происхождение. Однако, как уже продемонстрировали исследователи, такие «водяные знаки» можно легко обойти. К тому же существуют и продолжат существовать опенсорсные ИИ-инструменты, которые вообще не маркируют контент никакими «водяными знаками».

* Принадлежит компании Meta. Деятельность Meta Platforms признана экстремисткой и запрещена в России.