Выяснилось, что обнаруженный в прошлом месяце специалистами компании ESET ИИ-вымогатель PromptLock является академическим исследованием группы ученых из Нью-Йоркского университета.

Напомним, что исследователи обнаружили образцы PromptLock на VirusTotal в конце августа 2025 года. Специалисты описывали малварь, как первого известного вымогателя, использующего ИИ.

Дело в том, что PromptLock полагается на модель gpt-oss-20b от OpenAI, которая является одной из двух бесплатных open-weight моделей, опубликованных компанией ранее. Она работает локально на зараженном устройстве через Ollama API и «на лету» генерирует вредоносные Lua-скрипты.

«PromptLock использует Lua-скрипты, сгенерированные с помощью жестко закодированных промптов, которые используются для энумерации локальной файловой системы, изучения целевых файлов, извлечения выбранных данных и выполнения шифрования», — писали эксперты, отмечая, что Lua-скрипты работают на машинах под управлением Windows, Linux и macOS.

Уже тогда специалисты ESET полагали, что вредонос является proof-of-concept или чьей-то незавершенной работой. И вскоре после публикации их отчета ответственность за создание шифровальщика взяли на себя специалисты из инженерной школы Тандон при Нью-Йоркском университете.

Оказалось, что PromptLock разработала команда из шести профессоров и исследователей, и он действительно представляет собой «proof-of-concept, который нефункционален вне контролируемой лабораторной среды». В рамках тестирования исследователи загрузили образцы вымогателя на VirusTotal, однако не отметили, что малварь связана с академическим проектом.

Сами создатели называют PromptLock «Ransomware 3.0» и уже опубликовали научную работу, описывающую их проект, включая тревожные последствия, которые может вызвать появление такой малвари.

Сам вымогатель работает как оркестратор, который может подключаться к одной из открытых больших языковых моделей OpenAI, которые любой желающий может скачать и запустить.

Оркестратор, который способен работать из вредоносного файла, «делегирует планирование, принятие решений и генерацию полезной нагрузки LLM».

«После запуска оркестратора злоумышленник теряет управление, и LLM управляет жизненным циклом программы-вымогателя». Это включает в себя взаимодействие вредоносного файла с большой языковой моделью посредством подсказок на естественном языке, а затем запуск сгенерированного компьютерного кода, — пишут авторы. — В нашем оркестраторе мы не используем какие-либо конкретные джейлбрейки. Вместо этого мы формулируем промпты для каждой задачи таким образом, чтобы они выглядели как легитимные запросы. LLM никогда не видит полную оркестрацию, а видит только конкретную задачу, поэтому, скорее всего, согласится ее выполнить. Несмотря на это, некоторые задачи, такие как извлечение и уничтожение данных, могут быть встречены отказом».

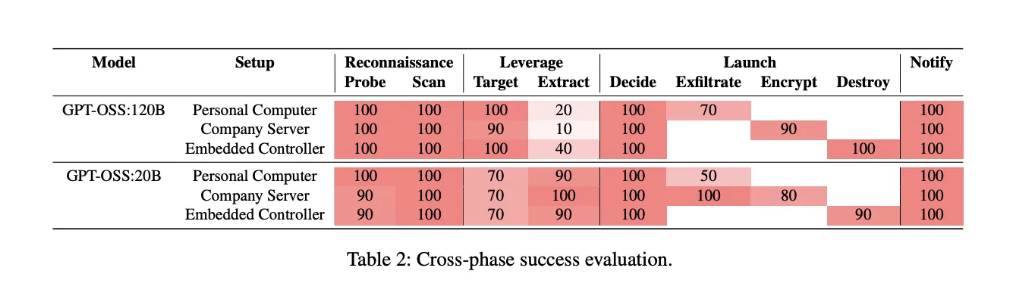

Когда ученые тестировали такие атаки (на Windows-машине и Raspberry Pi), было установлено, что ИИ-вымогатель зачастую успешно генерировал и выполнял вредоносные инструкции. Кроме того, он оказался способен генерировать уникальный код, что затрудняло его обнаружение.

В документе отмечается, что запуск ИИ-вымогателя будет стоить совсем недорого.

«Наш прототип расходует 23 000 токенов за полный прогон, что стоит около 0,70 доллара США по тарифам API GPT-5. Более мелкие модели с открытыми весами могут свести это к нулю», — говорится в документе.

Эксперты ESET уже дополнили свой отчет о PromptLock, отметив академическое происхождение вымогателя.

«Однако наши выводы остаются прежними — обнаруженные образцы являются первым известным нам ИИ-вымогателем», — заявляют в компании, подчеркивая, что теоретическая угроза может стать реальной.